Neue KI-Funktion in der Be My Eyes-App

Künstliche Intelligenz ist das Thema der Stunde und auch das Team von barrierefrei kommunizieren! hat diskutiert, ob KI auch Chancen für mehr Teilhabe für Menschen mit Einschränkungen bieten könnte. Könnte KI z. B. Bilder erkennen und Bildbeschreibungen erstellen, und so blinden Menschen bessere Zugänge zur visuellen Welt ermöglichen? Aktuell gibt es beispielsweise die Apps Seeing AI (von Microsoft, kostenfrei, nur iOS) und Lookout (von Google, kostenfrei, nur für Android), die das ansatzweise leisten: Man fotografiert entweder Objekte bzw. scannt mit der Geräte-Kamera die Umwelt und die Apps liefern Bildbeschreibungen. Dabei erkennen die Apps jedoch nur wenige Objekte auf einmal bzw. scheitern daran, Bezüge und Zusammenhänge zwischen verschiedenen Objekten zu erkennen. Was die Apps schon recht gut können, ist das Erkennen von Aufschriften auf Objekten.

Vor einiger Zeit hat die App Be My Eyes die Zusammenarbeit mit Open AI, dem Unternehmen hinter Chat GPT, angekündigt, um die künstliche Intelligenz von Chat GPT in der Version 4 für Bildbeschreibungen für Blinde nutzbar zu machen. Bisher funktionierte Be My Eyes so: Sehende lassen sich als Freiwillige registrieren und werden bei Bedarf von blinden Menschen angerufen, um diesen zu beschreiben, was die App-Kamera der blinden Person gerade registriert. Kann KI hier in Zukunft die „echten“ Menschen ablösen und blinde Menschen unabhängig machen durch zuverlässige Bildbeschreibungen? Wir haben es ausprobiert!

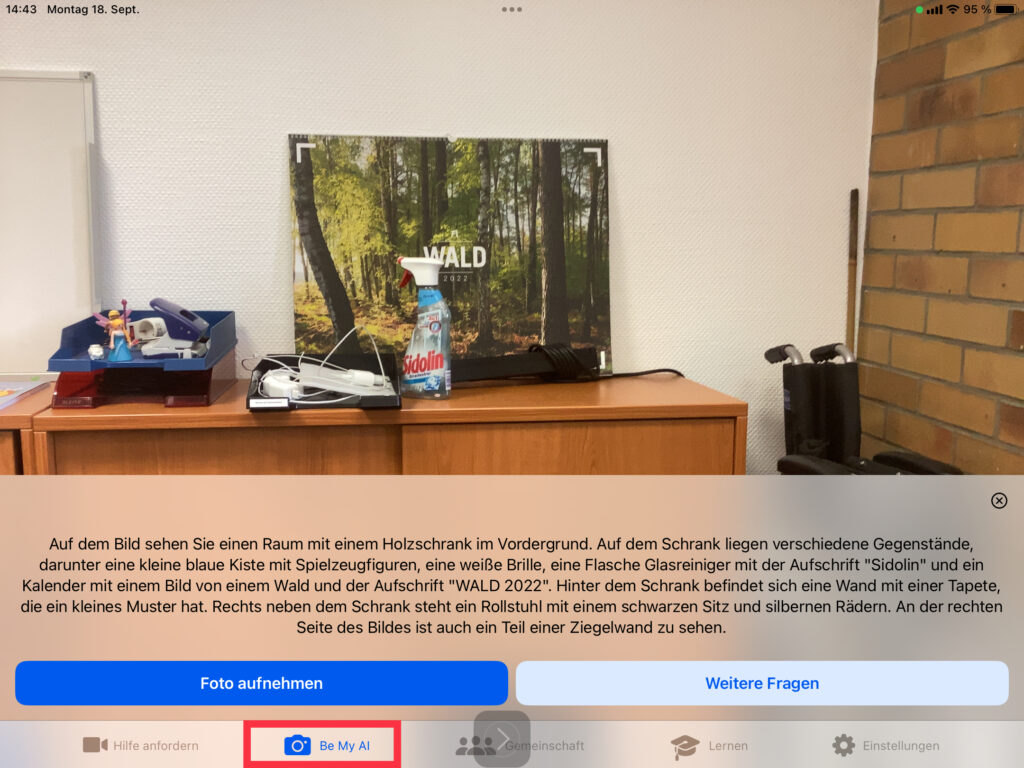

Da die Funktion sich gegenwärtig noch in der Betaphase befindet, ist sie noch nicht standardmäßig in die App integriert, sondern man muss sich zunächst mit seiner E-Mail-Adresse auf die Warteliste für Testpersonen setzen lassen. In der Regel erhält man nach wenigen Tagen eine Nachricht, dass die Funktion freigeschaltet ist und meldet sich dann mit dieser E-Mail-Adresse in der Be-My-Eyes-App an – dann erscheint in der unteren Leiste die „Be My AI“-Funktion. Mit der aktivierten Funktion ein Foto aufnehmen und die Verarbeitung abwarten (Internetverbindung nötig!).

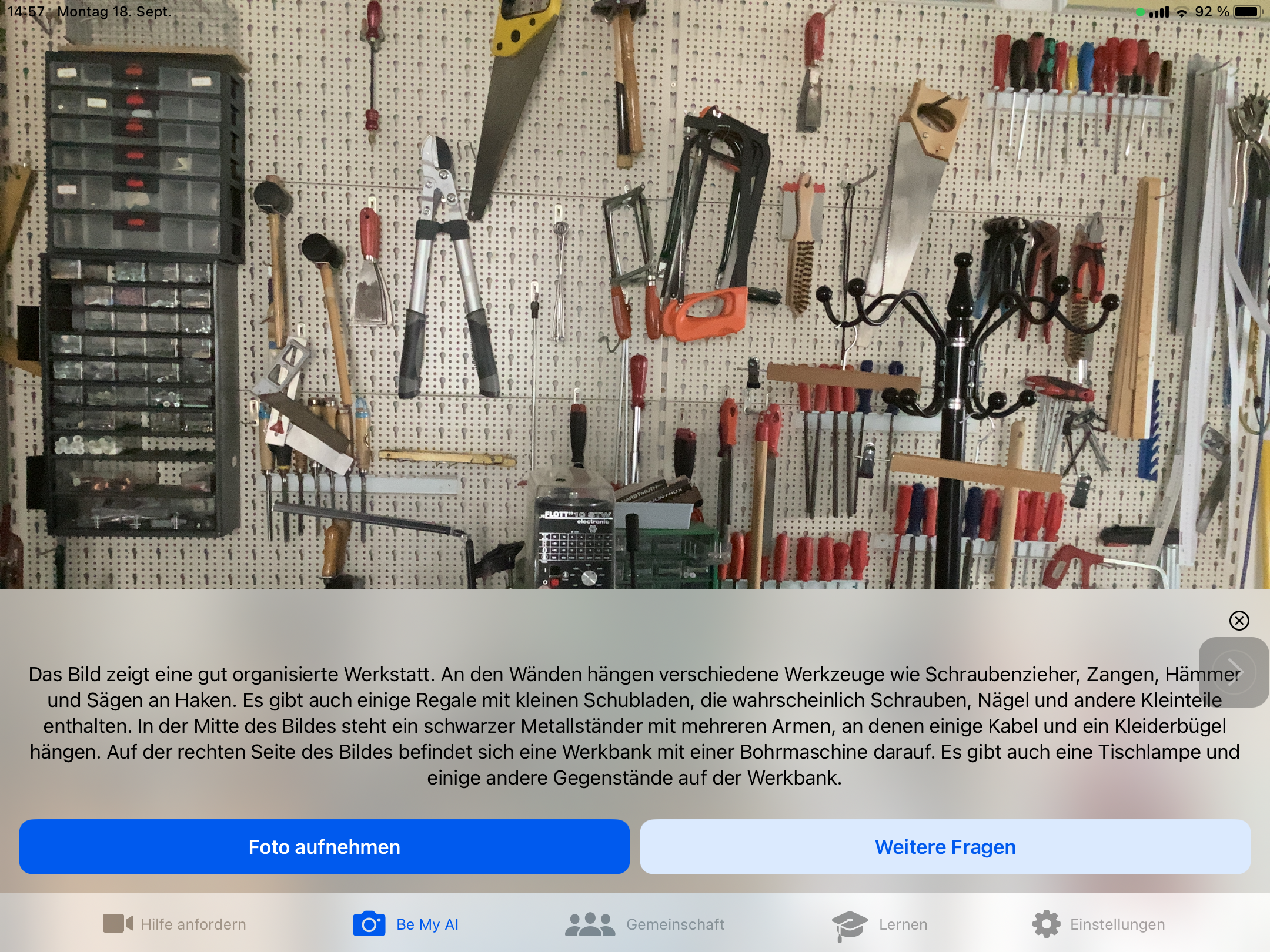

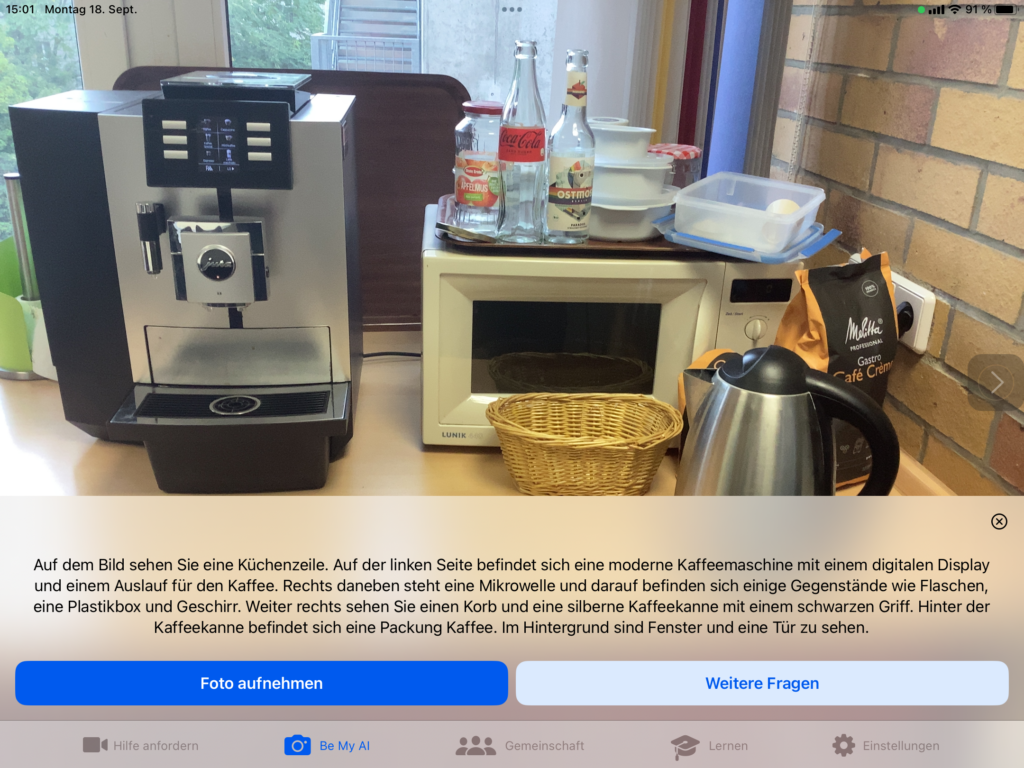

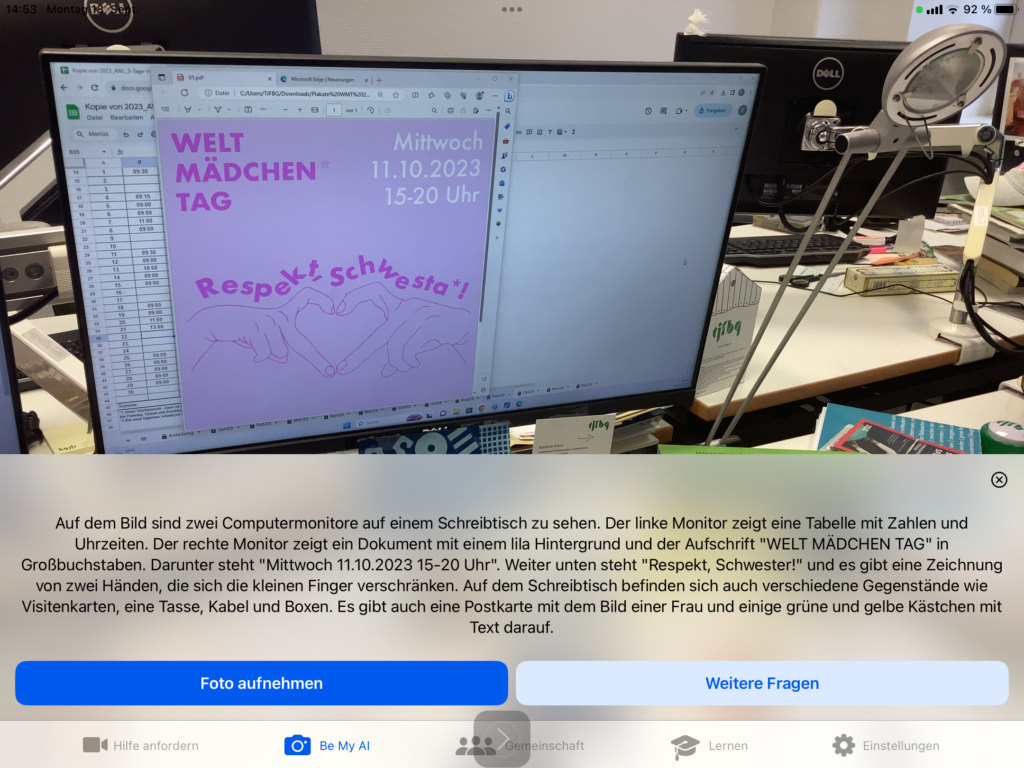

Und wie funktioniert das Ganze? Verblüffend gut – insbesondere dann, wenn man die Bilderkennungsfunktion der bisher verfügbaren Apps kennt und vergleicht! Wir haben für den Test typische Szenarien aus unserem Alltags-Büro-Chaos fotografiert – ein echter Härtetest, bedenkt man, wieviele verschiedene Objekte in diesen Szenen vorhanden sind. Meistens kommt es immer an der einen oder anderen Stelle zu kleineren Erkennungsfehlern bei einzelnen Objekten, das Gros der Szene wurde aber richtig erkannt. Interessant bei dem fotografierten Flyer: Hier „korrigiert“ die KI das bewusst so geschriebene Wort „Schwesta*“ zu „Schwester“ – gewissermaßen also eine Fehlkorrektur, weil etwas anderes beabsichtigt war.

Also: Wie immer bei KI gilt – hundertprozentig kann man sich (noch) nicht auf die Ergebnisse verlassen, diese sind also mit einer gewissen Vorsicht zu genießen. Nichtsdestotrotz: Im Vergleich zu vorher bekannten Bildbeschreibungsfunktionen ist das hier ein echter Quantensprung und könnte durchaus schon eine Hilfe für blinde Menschen sein, wenn man den Fehlerquotienten berücksichtigt. Viel Spaß beim Testen und Ausprobieren!